Robots entre nosotros (2da parte)

(19 de noviembre, 2023). Fernando Nunez-Noda, Director de Maquinamente (Link a la 1er parte)

Los Robots en la Literatura y el Cine (2da parte)

(Atención: Puede haber spoilers.)

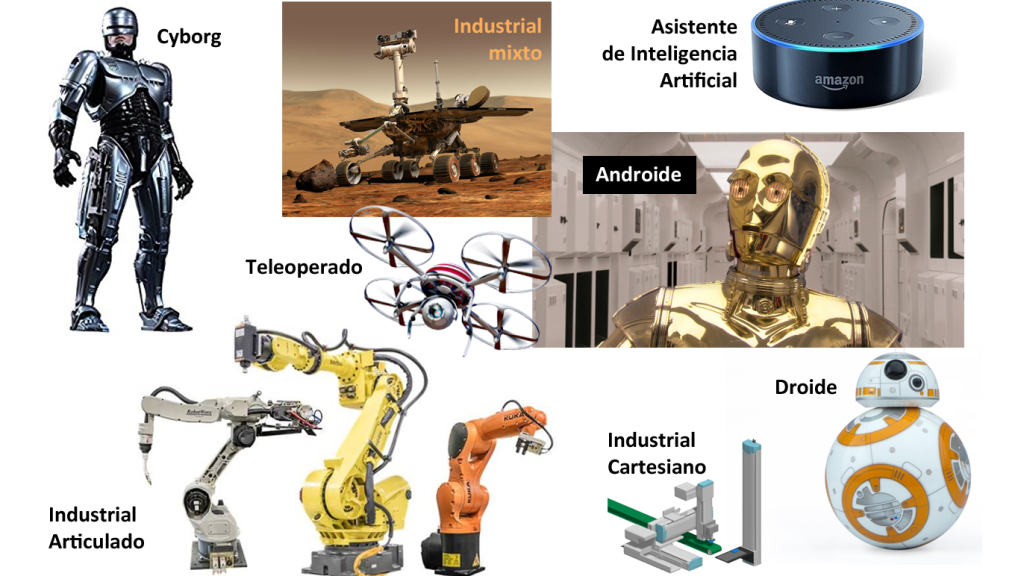

Pero los robots interesantes son los que se parecen a nosotros y, paradójicamente, tienen el potencial de hacernos añicos (así somos). Tomemos Terminator con Arnold Schwarzenegger por ejemplo. Son androides, es decir, robots humanizados que caminan, sujetan objetos, ven, escuchan y hablan, también son capaces de sensaciones táctiles.

Vale decir que ya hay androides entre nosotros, como ASIMO (suena como un tal Isaac y su foto está a la derecha), fabricado por Honda y capaz de un rango bastante amplio de movimientos. Camina como ningún robot hasta ahora, sube y baja escaleras, sortea obstáculos, reconoce objetos e incluso rostros. Responde a sonidos y cambios diversos en sus alrededores.

Vale decir que ya hay androides entre nosotros, como ASIMO (suena como un tal Isaac y su foto está a la derecha), fabricado por Honda y capaz de un rango bastante amplio de movimientos. Camina como ningún robot hasta ahora, sube y baja escaleras, sortea obstáculos, reconoce objetos e incluso rostros. Responde a sonidos y cambios diversos en sus alrededores.

En cambio el de Robocop (1987) es un cyborg, al igual que Darth Vader de la famosa Guerra de las Galaxias. Son humanos a quienes se les han incorporado elementos robóticos para completarlos o mejorarlos. El primero está del lado de la ley pero no deja de tener profundos conflictos por su condición mixta. El segundo es un villano que aprovecha al máximo sus atributos robóticos para aplastar a sus enemigos.

Tan temprano como 1941, el autor estadounidense Isaac Asimov usó por primera vez el término “robótica” y predijo el advenimiento de la industria de los autómatas. En su libro de cuentos I, Robot (del cual se hizo una película en 2004 con Will Smith) Asimov expuso las famosas “3 Leyes de la Robótica”:

Primera Ley: “Un robot no hará daño a un ser humano, ni permitirá con su inacción que sufra daño.” Segunda Ley: “Un robot debe cumplir las órdenes dadas por los seres humanos, a excepción de aquellas que entren en conflicto con la primera ley.” Tercera Ley: “Un robot debe proteger su propia existencia en la medida en que esta protección no entre en conflicto con la primera o con la segunda ley.”

Luego le agregó una Ley Cero: “Un robot no hará daño a la Humanidad o, por inacción, permitir que la Humanidad sufra daño.”

El argumento de “I, Robot” sigue una línea común en las historias de entidades cibernéticas autoconscientes: llegan a equiparse con los humanos, sus creadores, y por supuesto en algún momento quieren independizarse y ser realmente autónomos socialmente. Un equivalente, quizá, a la emancipación de los esclavos.

Antes hablé de 2001 Odisea Espacial. Es bueno notar que HAL-9000, la computadora inteligente de la nave, tiene un conflicto ético cuando se le obliga a mentir y, eventualmente, a asesinar para poder cumplir una misión que los astronautas no conocían.

Más ligeros, aunque no ajenos a conflictos morales y de conciencia, son los autómatas de Star Wars. C3PO es un androide pero R2D2 o BB8 son “droides”, es decir, capaces de inteligencia humana pero sin aspecto humano.

Blade Runner (1983) es una obra maestra del director Ridley Scott (basada en un cuento de otro genio de la sci-fi, Phillip K. Dick) plena de dramatismo del lado de los humanoides. Fabricados a imagen y semejanza de sus creadores, capaces de razonamientos profundos y emociones, los androides de esta película son –en muchos sentidos- más humanos que los humanos mismos. El problema es que tienen un tiempo de vida prefijado y corto. En un mundo sucio, superpoblado y deprimente, el detective se da cuenta que sus perseguidos robóticos aprecian mucho más la vida que él mismo y tienen un sentido poético de la existencia que se ha perdido en ese mundo distópico.

The Matrix (1999) ofrece un tipo muy diferente de robots. Digamos: seres hechos de realidad virtual, en un mundo simulado que esconde una absoluta tiranía de las máquinas, de las computadoras que usan a los humanos como baterías vivientes y a cambio le dan la apariencia de realidad cotidiana.

En esa película el robot es también un universo ilusorio que unos pocos rebeldes tratan de desmantelar para vivir algo más real y propio. Un eco -quizá- de la ilusión del mundo que denunció Buda y a la cual hay que renunciar con una nueva conciencia con la realidad.

Decíamos, pues, que Turing se preguntó si los cerebros electrónicos llegarían a ser inteligentes. La inteligencia humana deduce, induce, infiere, imagina, adivina, especula. En 1997 Deep Blue, un sistema computacional de IBM, «derrotó» a Gary Kasparov -campeón de entonces y acaso el mejor jugador de todos los tiempos- en un match de ajedrez de varias partidas. Deep Blue produce millardos de configuraciones complejas a partir de reglas simples que se agregan y concatenan, de modo que parecen realizadas, no sólo por un humano, sino por uno superdotado. Eso sí, sólo en ajedrez.

Lo más pertinente sería pensar que Deep Blue sí demuestra inteligencia, pero no enteramente suya, sino “prestada” de sus creadores y programadores. En otras palabras, quienes ganaron fueron los creadores de los algoritmos, las reglas que sigue el sistema en todos los casos posibles. En sucesivos intentos, Kasparov no pudo derrota a su némesis electrónica.

Deep Blue no es solo una prolongación de las capacidades ajedrecísticas de sus programadores, sino una superación de sus limitaciones, dado que puede procesar información como no pueden sus hacedores individual o colectivamente. Además, Deep Blue es capaz de responder a muy complejas estrategias de engaño y sutileza. Puede simular, cambiar de plan sobre la marcha. Un genio, pues.

Kasparov protagonizó otros dos matches, en 2003, contra programas computacionales distintos a DeepBlue. Ambos resultaron tablas. En 2006 el campeón mundial de entonces, Vladimir Kramnik, jugó contra un”nieto” de DeepBlue llamado Deep Fritz. La computadora le ganó 4 juegos a 2. Wikipedia da cuenta que, según conocedores, en la última partida sencillamente lo aplastó.

Parece que la distancia crecerá a favor de la computadora como ya ha ocurrido en tantas áreas. El campeón mundial actual, el hindú Viswanathan Anand, tiene un puntaje ELO en la Federación Mundial de Ajedrez de 2.817. Un “motor ajedrecístico” de 2010, llamado Rybka, tiene un ELO estimado de 3.200 puntos. Y actualmente, por cierto, hay programas que corren en móviles a nivel de Gran Maestro.

En 2011 IBM probó Watson, una súper computadora de notoria cultura general y especializada, capaz ya no de responder a un limitado conjunto de mensajes prefijados, sino al lenguaje natural. Ese año participó en igualdad de condiciones en el programa de TV Jeopardy y lo ganó resonantemente. Como sabemos, en ese show las preguntas son ambiguas, muy variopintas, con juegos de palabras que hacen que sus ganadores sean personas muy preparadas y especiales. ¿Qué nos dice esto de los cerebros electrónicos?

El traslado de inteligencia fuera de la mente, a cerebros mecánicos que imitan algunos aspectos no tan rudimentarios del pensamiento, es lo que llamamos «inteligencia artificial». Estamos, eso sí, a enorme distancia de un pensamiento artificial autónomo, inductivo o emotivo, pero hay razones para celebrar los triunfos sobre campeones de ajedrez o concursantes nerds. Eso revela el poder de la inteligencia combinada y condesada fuera del cerebro para que «piense» por sí misma.

Epílogo

Por tanto, hay dos visiones. Una optimista: los robots nos facilitarán la vida, sustituirán al humano en todo tipo de tareas peligrosas o tediosas, nos ayudarán a ganar guerras contra terroristas, a conquistar planetas fuera del nuestro y una largo etcétera.

Los profetas del desastre resaltan los dilemas éticos, el enorme desempleo que provocarán, la tiranía de las tostadoras inteligentes para que no comamos panes genéticamente modificados y un eventual enfrentamiento cuando –cual replicantes de Blade Runner- reclamen independencia y posiblemente supremacía.

Y un científico loco diría, alumbrado desde abajo con una linterna: “¡Las máquinas malévolas nos alcanzan ja ja ja ja!”. Ahora son móviles e inmateriales…

___________________________________________

Imagen: MM.