Fernando Nunez-Noda, Editor de Máquinamente.

Un épico triunfo de la máquina que es, en el fondo, un logro humano para las épocas.

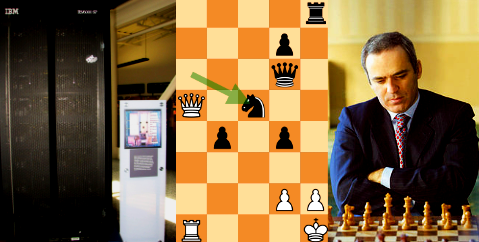

(Sep. 23, 2023). Hace 27 años el excampeón mundial de ajedrez Gary Kasparov se enfrentó por primera vez con un rival inusual: la supercomputadora Deep Blue, de IBM, que sorprendió al mundo porque en 1996 Kasparov le ganó con mucha dificultad, pero al año siguiente la máquina se impuso en un rematch. Vale decir que Kasparov es, según consenso, el mejor ajedrecista (humano) de la historia.

Para mis clases (de tecnología en la Escuela de Periodismo) en la Universidad Católica Andrés Bello en Caracas, Venezuela, solía usar estos históricos encuentros para explicar los modelos y esquemas de la comunicación social. Comparto algunas reflexiones al respeto:

La inteligencia artificial es humana

Se atribuye al matemático inglés Alan Turing (1912-1954, en la foto) la creación de la «informática» o «computer sciences», como es llamada en inglés. En 1936 escribió los principios que rigen la computación moderna y llegó más allá, hasta preguntarse si los cerebros electrónicos podían algún día ser inteligentes. No es casualidad que en el cubículo frío y liso de Hal 9000, la computadora pensante del film 2001: una Odisea Espacial (1969), solo mostrara un pequeño retrato de este matemático.

La «máquina de Turing» (1936), un aparato imaginario capaz de imitar procesos inteligentes humanos tan sólo si se presentan como “algoritmos”, se considera el gran predecesor de las computadoras y de los programas actuales. Deep Blue, el sistema computacional de IBM que «derrotó» a Gary Kasparov en 1997, es una máquina de Turing porque produce millardos de configuraciones complejas a partir de reglas simples que se agregan y concatenan, de modo que parecen realizadas, no sólo por un humano, sino por uno superdotado.

La «máquina de Turing» (1936), un aparato imaginario capaz de imitar procesos inteligentes humanos tan sólo si se presentan como “algoritmos”, se considera el gran predecesor de las computadoras y de los programas actuales. Deep Blue, el sistema computacional de IBM que «derrotó» a Gary Kasparov en 1997, es una máquina de Turing porque produce millardos de configuraciones complejas a partir de reglas simples que se agregan y concatenan, de modo que parecen realizadas, no sólo por un humano, sino por uno superdotado.

Más que la máquina, a mí me llama la atención la célebre «prueba de Turing». Consiste en un «juego de imitación» por el cual un participante hace las mismas preguntas binarias a un humano y a una máquina, sin saber cuál es cuál, dado que ambos están ocultos. El punto es averiguar cuán lejos puede sostenerse el engaño de la máquina, es decir, cuántas preguntas pueden hacerse hasta que quede en evidencia cuál es la máquina.

¿Cuál es el humano, cuál la máquina?

Como un trabajo para mis alumnos de comunicación social, en la UCAB, re-imaginé la prueba así: Gary Kasparov está sentado frente a una pared, hay dos monitores de computadora con tableros exactos, cada uno con un teclado. Un monitor está conectado a una computadora operada en tiempo real por un grupo de jugadores y sus asesores, el otro está conectado a Deep Blue. El campeón mundial de ajedrez desconoce quién o qué está detrás de cada monitor.

Si Kasparov juega contra ambos «contendores» la pregunta es: «cómo y cuándo sabe cuál es manejada por humanos o por Deep Blue». Si tarda mucho en delatar a la máquina o no lo hace del todo, entonces aquella imita muy bien la inteligencia deductiva humana.

Pedí a mis alumnos una reflexión sobre esta prueba de «Turing-Kasparov». ¿Hay comunicación en el caso de Deep Blue? Si Kasparov no identifica a Deep Blue ¿se puede hablar de algún tipo, aunque sea primitivo, de inteligencia?

Ambos y ninguno

La respuesta es que ni yo mismo estaba muy claro. Mis alumnos, que son muy inteligentes y creativos, también divagaron. Uno piensa en Deep Blue, al principio, como algo que tiene una conciencia propia, en vez de un entramado de cables y de códigos. Como los gatos, sólo nos llama la atención lo que se mueve, lo que actúa en el momento, de modo que la máquina trabajando nos parece un interlocutor. 85% de los alumnos indicó que Kasparov y Deep Blue tienen una relación emisor-receptor similar a la que tendría con humanos.

Cuando Kasparov juega contra el equipo de maestros no hay máquina de Turing. Pero entonces ¿qué ocurre cuando Kasparov juega con Deep Blue?

Visto como un circuito cerrado, decir que entre el campeón mundial de ajedrez y una máquina hay comunicación es anatema, porque la comunicación (social) es humana. Si no, lo que le gritamos a nuestras computadoras sería un insulto, no una descarga de frustración. Según el paradigma tradicional, sólo se completa un circuito comunicacional cuando el emisor y el receptor son seres pensantes y no, uno de ellos, un sistema seudopensante.

Comunicación parecida a la humana ¿sí o no?

Ahora bien, en un espectro más amplio, el match Kasparov-Deep Blue sí puede implicar comunicación después de todo. En efecto, si vamos más allá, hallamos un diálogo entre Kasparov y los programadores del sistema. En este sentido, no importa que los programadores estén presentes o embebidos en el programa, que actúa incluso cuando ellos duermen. Lo importante es que ellos previeron el diálogo, en forma de algoritmos, de modo que Deep Blue simula la interacción real de un jugador humano, en este caso, uno de los mejores del mundo.

Los medios masivos, como la televisión o la prensa, ofrecen mensajes iguales para todo su público (todos ven la misma telenovela, todos leen esta misma página). La computación, al ser programable, permite que diversos usuarios sigan diferentes caminos. Con Kasparov, Deep Blue ejecuta una partida de nivel mundial. Conmigo, me despacha en pocos movimientos.

Cuando usted diseña un programa de computación o una página web, prepara de antemano una historia, pero no la misma para todos, sino la que cada quien va haciendo, de la forma «si entra por aquí, se le responde así; si hace clic en aquello, ocurre esto otro, etcétera». Esa secuencia de instrucciones condicionadas, ese diálogo semi-programado, es lo que llamamos “algoritmo”.

Deep Blue es una prolongación, no sólo de las capacidades ajedrecísticas de sus programadores, sino de sus habilidades comunicacionales, dado que la computadora y su software son capaces de responder a muy complejas estrategias de engaño y sutileza. Puede simular, cambiar de estrategia sobre la marcha…

Deep Blue no tiene voluntad ni conciencia, pero sus programadores sí. Por ejemplo, «enrocar antes de nueve jugadas», «dominar el centro del tablero», «forzar tablas» son muy complejos juegos de posibilidades. Sobre esta base se construye una programación que anticipa las respuestas de un contrincante junto a sus propias intenciones, que las tiene el Kasparov.

En resumen: hay inteligencia en ambos casos. Contra los expertos en vivo no hay duda, porque todos son humanos. Mas en Deep Blue también, porque realmente Kasparov sigue jugando contra sus programadores, pero en tiempos diferidos.

La «inteligencia artificial» es el traslado de inteligencia fuera de la mente, a cerebros mecánicos que imitan algunos aspectos no tan rudimentarios del pensamiento.

Estamos, eso sí, a enorme distancia de un pensamiento artificial más sofisticado o emotivo, pero hay razones para celebrar ese pequeño triunfo contra Kasparov, porque revela el poder de la inteligencia combinada y condesada fuera del cerebro para que «piense» por sí misma.

___________________________________________________________

A pesar de las afirmaciones de algunos expertos, como John R. Searle, quien sostiene que «… una computadora debidamente programada es realmente una mente, en el sentido de que se puede afirmar literalmente que las computadoras que reciben programas adecuados comprenden y tienen estados cognitivos», la mayoría tiende a estar en desacuerdo. En general, la opinión predominante respecto a los robots modernos descarta la idea de que posean conciencia, considerándolos máquinas operadas por humanos en lugar de seres conscientes.

A pesar de las afirmaciones de algunos expertos, como John R. Searle, quien sostiene que «… una computadora debidamente programada es realmente una mente, en el sentido de que se puede afirmar literalmente que las computadoras que reciben programas adecuados comprenden y tienen estados cognitivos», la mayoría tiende a estar en desacuerdo. En general, la opinión predominante respecto a los robots modernos descarta la idea de que posean conciencia, considerándolos máquinas operadas por humanos en lugar de seres conscientes.

La «máquina de Turing» (1936), un aparato imaginario capaz de imitar procesos inteligentes humanos tan sólo si se presentan como “algoritmos”, se considera el gran predecesor de las computadoras y de los programas actuales. Deep Blue, el sistema computacional de IBM que «derrotó» a Gary Kasparov en 1997, es una máquina de Turing porque produce millardos de configuraciones complejas a partir de reglas simples que se agregan y concatenan, de modo que parecen realizadas, no sólo por un humano, sino por uno superdotado.

La «máquina de Turing» (1936), un aparato imaginario capaz de imitar procesos inteligentes humanos tan sólo si se presentan como “algoritmos”, se considera el gran predecesor de las computadoras y de los programas actuales. Deep Blue, el sistema computacional de IBM que «derrotó» a Gary Kasparov en 1997, es una máquina de Turing porque produce millardos de configuraciones complejas a partir de reglas simples que se agregan y concatenan, de modo que parecen realizadas, no sólo por un humano, sino por uno superdotado.